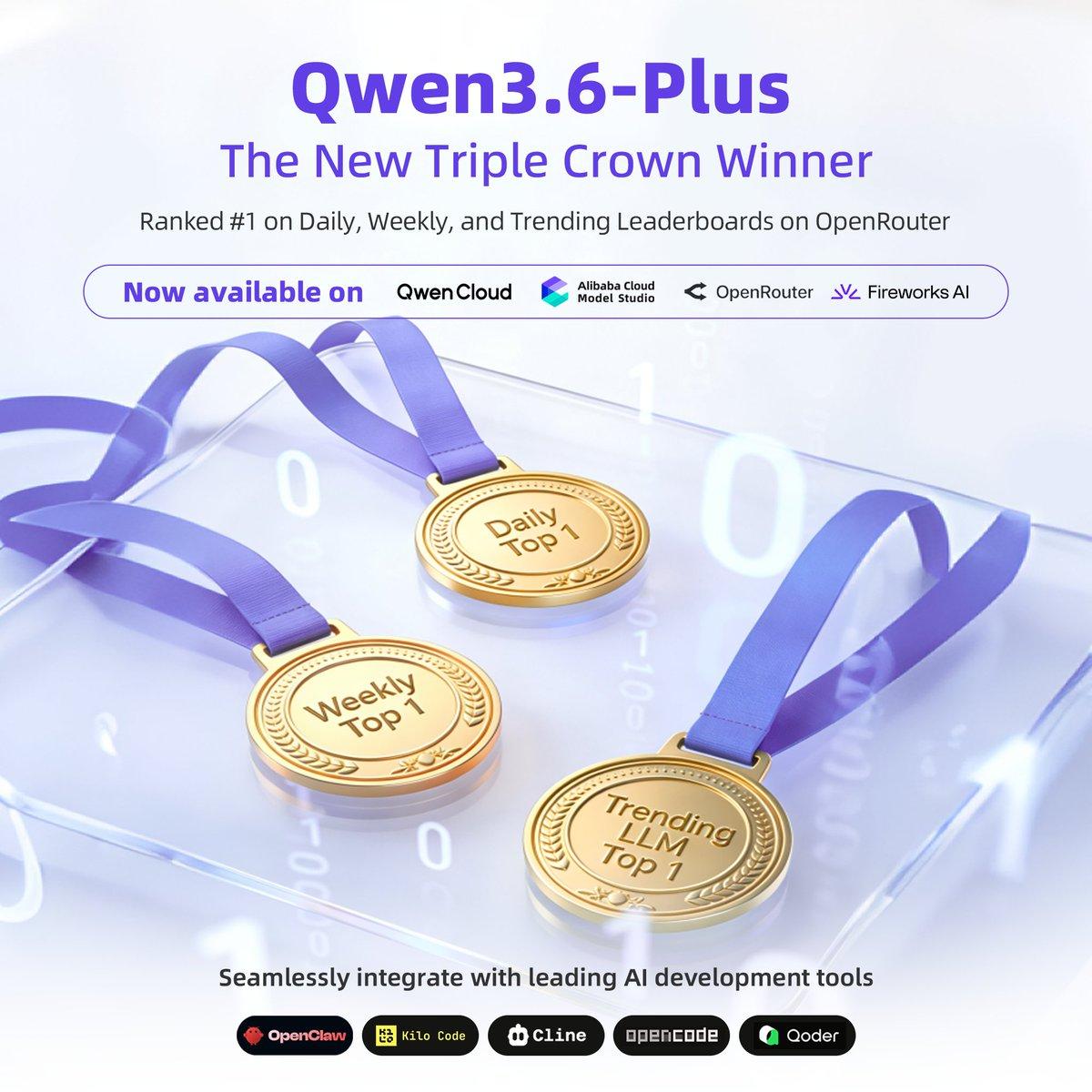

Alibaba выпустила Qwen 3.6-Plus, и модель быстро вышла в лидеры на OpenRouter. По данным самой платформы, Qwen 3.6 Plus уже активно используется в продакшене, а сторонние публикации и посты Alibaba Cloud отдельно указывают, что модель заняла первое место по недельному потреблению токенов и поднималась в ежедневных рейтингах OpenRouter. Но формулировку про «одновременное первое место в Daily, Weekly и Trending» стоит считать не до конца подтвержденной: на доступных публичных страницах OpenRouter это в явном виде не зафиксировано.

Сама модель официально была представлена 2 апреля 2026 года. Alibaba подает ее как новый флагман для реальных агентных задач, с акцентом на кодинг, работу на уровне репозитория и длинный контекст. На OpenRouter для Qwen 3.6 Plus указан контекст в 1 миллион токенов, а в описании модели отдельно выделены улучшения в agentic coding, фронтенд-разработке и reasoning.

С точки зрения доступности модель уже не выглядит экспериментом. Она есть как минимум на OpenRouter и Fireworks AI. Fireworks прямо указывает, что Qwen 3.6 Plus доступна в serverless-режиме с оплатой за использование и в dedicated deployment без rate limits. На OpenRouter модель тоже выведена как полноценный production-вариант с публичной страницей провайдеров, ценой и статистикой активности.

По цене картина выглядит агрессивно. OpenRouter показывает тариф около $0.325 за миллион входных токенов и $1.95 за миллион выходных, а Fireworks указывает $0.50 за миллион входных, $0.10 за cached input и $3.00 за миллион выходных токенов. Это не доказывает автоматически, что модель выгоднее конкурентов в каждом сценарии, но делает ее заметно привлекательнее для команд, которые считают экономику агентных пайплайнов не по бенчмаркам, а по реальному токенопотреблению.

По первым признакам Qwen 3.6-Plus действительно выглядит как один из самых сильных кандидатов под продакшен-сценарии этой весны. Но вывод о том, что модель уже безусловно лучше конкурентов, был бы слабым. Лидерство в рейтингах OpenRouter показывает высокий спрос и хорошую цену, но не заменяет проверку на собственных задачах. Для практического выбора важнее другое: как модель держит длинный контекст, насколько стабильно проходит сложные multi-step цепочки и не сыпется ли на реальных агентных workflow.